张一鸣被称为“魔王”,AI与人类如何“价值对齐”引关注

张一鸣被称为“魔王”,AI与人类如何“价值对齐”引关注

“人工智能将塑造这个世界的恶魔,而被恶魔附身的人们却浑然不知。” 陈卫星这样形容被困在“信息茧”中的人。

无论陈卫星这样做是为了吸引眼球和流量,还是真的担心人工智能控制人类意识和行为,人工智能伦理治理都是人类必须面对和思考的问题。

当前,与其担心人类是否会被人工智能奴役,更担心的是人类是否会被人类奴役。

“张一鸣想做意识形态皇帝,他搞的所谓算法AI就是为了钱来控制人类!”

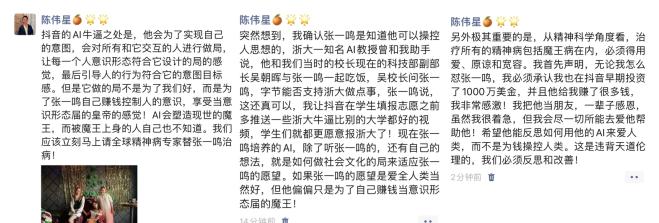

近日,字节跳动早期投资人陈卫星在微信朋友圈发布一系列帖子“炮轰”张一鸣和抖音,言辞颇为犀利。

在陈卫星看来,抖音为了达到自己的意图,利用算法推荐等AI技术,瞄准所有与其互动的互联网用户,最终引导用户的行为符合其预定目标。

“人工智能将塑造这个世界的恶魔,而被恶魔附身的人们却浑然不知。” 陈卫星这样形容被困在“信息茧”中的人们。

陈卫星现任梵城控股有限公司、梵城资本董事长。 他是快的出租车的创始人。

截至目前,张一鸣、抖音、字节跳动均未对陈卫星的言论进行公开回应。

值得注意的是,在张一鸣的这次“炮轰”之后,陈卫星在微信群里表示,他将回来以完全透明的方式创建一个名为抖音的新社交媒体平台。 陈卫星将其命名为“5210工程”,并号召国内人工智能人才加入。

无论陈卫星这样做是为了吸引眼球和流量,还是真的担心人工智能控制人类意识和行为,人工智能伦理治理都是人类必须面对和思考的问题。

早在三年前,复星国际董事长郭广昌也曾批评张一鸣,称“新闻不能只是给用户想看什么就看什么……”。

01 张一鸣被批为金钱操纵人类的“魔鬼”

陈卫星一向直言不讳。 他曾愤怒批评币圈大佬割韭菜的行为,被戏称为区块链圈的“直男”。

日前,他再次向张一鸣和字节跳动“开炮”。

1月5日,陈卫星在微信朋友圈发布多段文字,谴责抖音AI,直言抖音“用AI控制人类意识”,并多次用“魔鬼”一词来形容张一鸣。

陈卫星指出,为了实现自己的意图,抖音的AI会对所有与之互动的人做出决策,让每个人的意识形态与其设计的感觉相匹配,最终引导用户的行为与其预期目标相匹配。

在陈卫星看来,抖音AI这么做并不是为了用户的利益,而是为了张一鸣为自己赚钱,控制人们的意识,享受当思想皇帝的感觉。

陈卫星担心AI会塑造现实世界中的恶魔,但被恶魔控制的人们却不会知道。

为了证明他确认张一鸣知道他可以控制人的思想,陈卫星举了一个例子:

浙江大学一位知名AI教授曾告诉陈卫星的助手,他和学校领导、张一鸣一起吃饭时,领导问张一鸣,字节是否可以支持浙江大学做一些事情。 对此,张一鸣回应称,他可以让抖音在学生填写申请前多推送一些浙江大学比其他大学更好的视频,这样学生就会更倾向于申请浙江大学。

除了批评抖音和张一鸣之外,陈卫星还透露自己是抖音的早期投资人,投资了1000万美元,为自己赢得了巨额回报。

尽管如此,他还是希望张一鸣能够反思一下如何利用人工智能造福人类,而不是为了赚钱而操纵人类。

对于陈卫星“炮轰”张一鸣和抖音的言论,网友们看法不一。

有声音认为,算法推荐给人们带来更多便利的同时,也限制了人们获取不同观点和信息的机会。 人们确实应该意识到算法的局限性。

有网友认为,陈卫星如此极端的表情可能是为了为自己的新项目吸引关注和流量。

1月6日晚,陈卫星在微信群聊中表示,他将卷土重来,以完全透明的方式在抖音打造一个新的社交媒体平台……用超(值)对齐让AI爱人类。

所谓“价值对齐”,实际上就是将AI的价值观与我们人类的价值观对齐。

陈卫星将其命名为“5210工程”,并号召国内人工智能人才加入。

无论陈卫星关于“炮轰”张一鸣和抖音的言论是为了吸引眼球和流量,还是真的担心“AI控制人类”,AI伦理治理都是人类必须面对和思考的问题。

02 算法推荐存在隐忧,AI伦理治理需关注

有人说,互联网是一个供养社会。 这种喂食是经过大数据分析和机器学习决策后推送给人们的。

陈卫星所谴责的抖音AI正是这样一种算法推荐技术。

简单来说,算法推荐技术直接或间接决定了用户能看到什么。

基于人工智能算法和个性化推荐引擎技术,平台可以根据每个用户的兴趣、偏好和行为数据推荐信息、视频、音乐等个性化内容。

用户所有的浏览记录、点赞、评论、分享等行为,以及用户的观看列表和搜索记录等信息都可能被算法“征用”,从而帮助应用分析活动轨迹、日常行为、观看次数等。习惯、地理位置、职业、年龄等维度挖掘用户兴趣,不断更新基于用户行为分析的用户模型。

早在2015年,张一鸣就在一次演讲中提到,用户使用时间越长,今日头条的推荐系统就会变得越来越好。 他形容做这个产品的感受是,系统有时候有上帝视角,可以俯视所有用户。

那么,AI算法推荐会影响人们的意识和行为吗? 答案无疑是肯定的。

如果想让用户逐渐丧失学习能力和思考能力,那么平台可以尽可能推荐低俗、泛娱乐、误导性等内容; 如果想让用户逐渐从保守的消费者转变为具有前瞻性的人,消费者可以推荐尽可能多具有炫富、攀比、享受等特点的内容; 如果你想让用户去某个景点旅游、去某家餐厅吃饭、在某所大学读书等等,你可以推荐尽可能多与之相关的内容……

另外,很多媒体都报道了抖音上有一个现象。 在同一个视频下的评论区,不同的账号看到的内容是不同的。 而且,显示的评论都偏向于自己的喜好,很少看到不寻常的声音。

虽然这种算法让应用更加被用户“理解”,但质疑的声音也越来越多。

只根据个人喜好精准推送感兴趣内容的算法,或者过度使用算法过滤信息,都会导致用户像蚕一样掉进“茧”里。

随着网民意识的增强,如何缓解公众对算法潜在操纵用户的担忧,是抖音未来需要思考和面对的问题。

它一问世,全球关于人工智能运用的争论就从未停止过。

人们在享受它给工作和生活带来的便利的同时,也担心自己的隐私是否会被人工智能窥视。

如今,人工智能应用的潮流已经到来。 随着人工智能不断渗透到我们生活的方方面面,如何平衡人工智能的利弊也成为摆在人们面前的重要问题。

当前,与其担心人类是否会被人工智能奴役,更担心的是人类是否会被人类奴役。

除了从立法和监管的角度加以完善外,作为技术开发商和盈利者,相关企业更应该牢记,通过一些“灰色”手段牟利并不是长久之计。

因为人工智能的发展注定不仅仅是一个技术问题或者法律问题,更是一个伦理问题。

本文来自微信公众号,作者:石慧芳,36氪经授权发布。