CVPR 2024:中科视语领跑工业大模型,工业混合专家模型再夺桂冠

近日,在全球权威的CVPR 2024视觉异常检测和创新性检测挑战赛中,中科视语AI团队提交的“少量样本异常检测使用专家混合模型”以0.818的出色成绩,从全球17个国家和地区,百余支顶尖AI团队中脱颖而出,摘下桂冠。这再次展现了中科视语在工业大模型领域的雄厚实力。

随着大模型技术的发展,技术先进性和性能卓越性的要求更加苛刻,中科视语持续坚定、专注投入大模型研发,深入磨炼“内功”,建立技术壁垒,夯实技术优势,正是凭借中科视语深厚的技术积淀和长期积累的市场经验,视语坤川工业大模型核心技术连续多次取得国际领先的成果。本次获奖,是继登顶2019 VideoNet视频内容识别挑战赛、2022道路损坏检测世界竞赛桂冠后的又一里程碑,这标志着中科视语在少样本逻辑/结构异常检测技术上取得了新的突破。也正是凭借持续的技术革新,中科视语在工业大模型领域积累了显著的竞争优势。

2024计算机视觉领域的顶级学术会议CVPR,是由IEEE计算机协会和计算机视觉基金会(Computer Vision Foundation,CVF)共同主办,是一年一度的全球计算机视觉领域与模式识别领域最顶尖的学术会议。其与ECCV(European Conference on Computer Vision)、ICCV(IEEE/CVF International Conference on Computer Vision)一起并称为计算机视觉领域的三大最高级别的顶级会议。

面对日益激烈的市场竞争和不断变化的技术环境,中科视语始终保持前瞻性思维和创新精神。为了高效节约成本并提高效率,我们持续更新迭代,在xx的基础上,采用了前沿的Mixture of Experts(MoE)架构。MoE架构的核心优势是旨在通过模块化的方式降低更多的成本,实现更大的推理规模和更快的推理速度。这一创新架构使我们在市场化竞争中更具优势。

MoE架构将复杂任务分解为多个子任务,由不同的“专家”模块并行处理。这种分工合作的方式不仅提高了处理效率,还实现了更精准的模型预测。通过降低冗余计算和资源消耗,我们能够以更低的成本实现更高的性能,从而在市场上形成更有优势的竞争地位。

图 1 中科视语AI团队斩获少样本逻辑/结构异常检测赛道(VAND 2.0)赛道第一名

少样本工业异常检测比赛VAND2.0

从飞机火车到螺丝螺母,工业产品在我们的生活中无处不在。为了保证这些产品能够正常发挥其功能,避免安全事故,在生产过程中进行异常检测是极为必要的。近年来,随着计算机视觉技术的飞速发展,基于深度学习的工业异常检测方法层出不穷,成为学术和工业界的研究热点。因此,CVPR会议连续两年举办VAND挑战赛,鼓励研究者进一步探索工业异常检测的有效方法。

本次VAND比赛分为两个赛道:

1.Adapt & Detect: Robust Anomaly Detection in Real-World Applications

2. VLM Anomaly Challenge: Few-Shot Learning for Logical and Structural Detection

研究团队参加的是第二个赛道,重点研究基于多模态模型的少样本逻辑和结构异常检测方法。比赛使用的数据集将常见的异常分为结构异常和逻辑异常两类。结构异常指的是诸如破损、划痕这种在正常样本上不会出现的异常情况;逻辑异常则指正常物品的错误组合。例如,每个塑料袋中应该包含一长一短两个螺丝钉、两个螺母、两个垫片。然而,在逻辑异常样本中,可能包含三个螺母,这类异常难以通过简单比对来判断,需要使用新的异常检测方式。

此外,赛道二在少样本设置下进行异常检测,即要求模型在训练期间从未见过来自测试数据集中的任何正常样本,只在推理期间提供少量正常样本以供参考,这要求方法具有较高的迁移能力。

图 2 正常样本、结构异常和逻辑异常示意图

图 3 研究团队在 CVPR 2024 的演讲汇报

图 4 研究团队在 CVPR 2024 的展示海报

基于混合专家模型的少样本异常检测方法AnomalyMoE

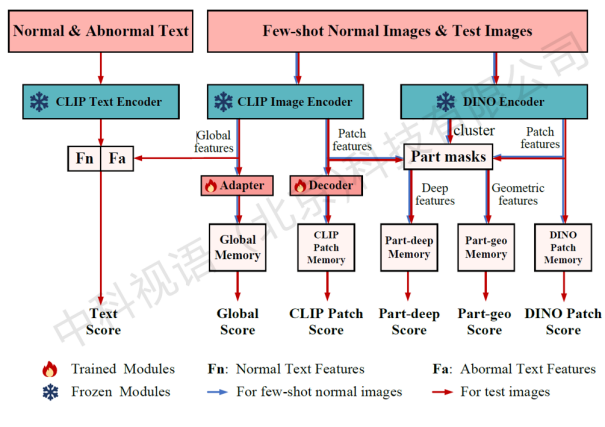

为了高效检测出不同类别的异常,研究团队提出了混合专家模型AnomalyMoE,充分发挥不同类型的异常检测方法的优势,使用 4 个不同的异常检测专家模型:图文异常检测专家模型,全局异常检测专家模型,子部分异常检测专家模型,图像块异常检测专家模型,并结合这四个专家模型的打分结果以得到最后的异常分数。

图 5 AnomalyMoE 结构图

图文异常检测专家模型FiLo

图文异常检测专家模型方面,研究团队主要使用了自己之前的工作FiLo [1],FiLo 创新性地使用大语言模型来为每一类物品生成其可能出现的异常种类,并使用可学习的文本向量来取代人工编写的文本模板,减少了工作量,提高了异常检测性能,并能够通过与图像特征最相似的文本描述内容来判断样品上的具体异常类型,提高了模型决策的可解释性。

全局异常检测专家模型

全局异常检测方面,研究团队使用视觉-文本多模态大模型CLIP提取图像全局特征,将测试样本的全局特征与少量正常样本的全局特征进行比较,根据与正常样本的相似度来判断图像中是否有异常。图文异常检测专家模型和全局异常检测专家模型在检测全局逻辑异常方面具有明显优势。

子部分异常检测专家模型

通过将图像分为多个子部分,异常检测方法能够方便统计每个子部分中的面积、数量、颜色,从而方便判断样本中的每个部分是否为异常。研究团队使用子部分异常检测专家模型,通过 DINO提取特征再聚类的方式得到每一个子部分的掩码,然后进行检测。子部分异常检测专家模型对于局部逻辑异常,如上文提到的螺母的新增、缺失等,具有良好的检测效果。

图像块异常检测专家模型AnomalyGPT

图像块异常检测专家模型通过比较测试图像的每个图像块和正常图像的每个图像块的内容,判断每个图像块是否为异常。在图像块异常检测专家模型的实现上,研究团队主要使用了他们在 AAAI 2024上发表的方法 AnomalyGPT [2],使用大语言模型实现工业异常检测,在少样本异常检测方面具有显著效果。

MoE架构的引入是中科视语技术创新之路上的又一重要里程碑。它不仅体现了我们对技术进步的不懈追求,也展示了我们在实现技术可持续发展和落地方面的坚定决心。未来,我们将继续探索和利用前沿技术,为客户提供更优质的服务,为社会创造更多的价值。

参考文献:

[1]Gu, Z., Zhu, B., Zhu, G., Chen, Y., Li, H., Tang, M., & Wang, J. (2024). FiLo: Zero-Shot Anomaly Detection by Fine-Grained Description and High-Quality Localization. arXiv preprint arXiv:2404.13671.

[2]Gu, Z., Zhu, B., Zhu, G., Chen, Y., Tang, M., & Wang, J. (2024, March). Anomalygpt: Detecting industrial anomalies using large vision-language models. In Proceedings of the AAAI Conference on Artificial Intelligence (Vol. 38, No. 3, pp.1932-1940).