多态模型LLaVA和GTP4差距缩小

GPT-4的视觉能力还没全量放开测试,开源对手就隆重登场了。

浙大竺院的一位校友,与微软研究院等机构合作推出了新版多模态模型LLaVA。

LLaVA在11个测试数据集上都成为了SOTA,在GitHub上更是斩获6k+星标。

开发者提供的数据显示,LLaVA的综合能力已经达到了GPT-4V水平的85%,在复杂推理任务上更是超过了96%。

读验证码、判断狗的品种,甚至根据图像生成网页代码……都难不倒LLaVA。

△

资源方面,LLaVA的样本量仅为120万,在单台8*A100的机器上,1天就能完成训练。

不过体验过的网友普遍表示,LLaVA离GPT-4V还存在一些差距。

那么LLaVA究竟表现如何,我们也实测了一番。

01 和GPT-4V有差距,但也能用为了更加直观地对比LLaVA和GPT-4V的表现,我们直接使用了微软发布的GPT-4V说明书中的案例。

首先来看最基本的人物识别。

这里GPT-4V说明书中使用的prompt是描述这张图,我们也如法炮制。

结果LLaVA不仅一个名字也没提,还把人数也数错了,但也判断出了这里面有足球运动员、演员和歌星。

于是我们继续追问LLaVA这些人的名字,结果它告诉我们信息量不足以判断。

这轮GPT-4V略胜一筹,不过或许是因为一下八个人太多了,于是我们又给LLaVA加试了一道简单些的题。

这次经过一轮追问,LLaVA成功认出了图片中的老马和小扎,所以这轮我们算它过关。

那如果是专业的图像呢?比如医学影像。

GPT-4V的答案是肺部感染或炎症,而LLaVA说的是吸烟或慢阻肺引发的凋亡细胞和瘢痕组织。

不过两个模型都没有确定自己的结论,都提示需要进一步检查,不过LLaVA给出的“黑色部分组织有异常”是正确的。

除了这些真·图像之外,文字识别也是多模态模型测试中的一项常见任务。

这张图中,LLaVA成功识别了里面的英文,但下面的日文片假名无论如何也认不出来。

除了上面这些正经的内容,LLaVA能不能解读表情包呢?

这次,LLaVA正确识别了图中的青蛙玩具和文字,而对表情包的解释,对了一半。

这个表情包讽刺的是有一群人发现自己错过了计划时间之后反而把预定事项推得更迟,LLaVA只说出了前面一半。

总结下来就是,GPT-4V的识别技能,LLaVA基本上也都会,但又都差点意思。

换言之就是,虽然没那么厉害,但也是能用的水平了。

那么,LLaVA是如何打造出来的呢?

02 由Vicuna和CLIP结合而成LLaVA的训练一共分为两个阶段。

首先是将文本与图像对齐的预训练过程,这一阶段一共使用了60万对图像-文本信息。

第二阶段则是在对齐的基础上使用视觉指令进行调优,让LLaVA熟悉用户可能问到的各种问题。

模型结构方面,LLaVA的语言模型是羊驼家族的Vicuna,视觉模型则采用了OpenAI的CLIP,并以MLP作为模态连接器。

为了让LLaVA能够识别更多专业领域的内容,研究团队在开发过程中还使用了ScienceQA数据集。

开发过程完毕之后,研究团队使用GPT-4对LLaVA的输出内容进行评价。

利用COCO数据集中的内容,开发者设计了三种类型的问题,然后让LLaVA输出答案并交给GPT-4评分。

问答式对话:将COCO数据集中的问题改编成问句进行提问

细节描述:要求LLaVA对图像内容提供更详细具体的说明

复杂推理:要求LLaVA在理解的基础上推理出图像中没有直接显含的信息(如:人物关系)

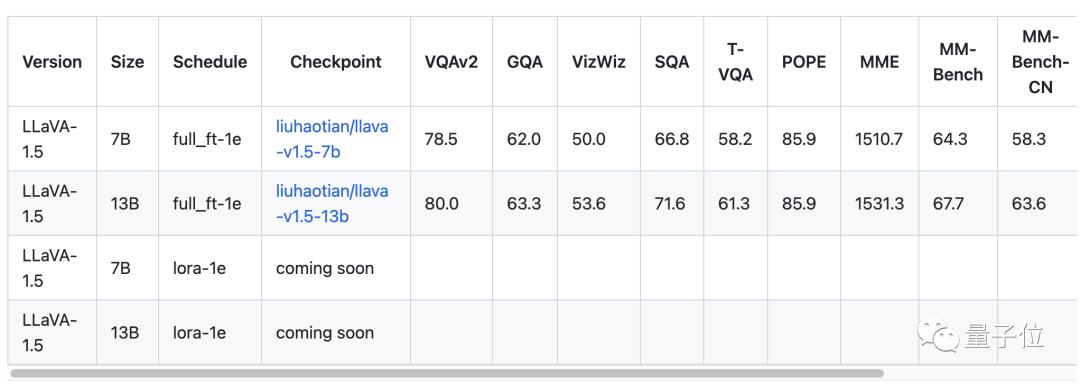

目前,LLaVA的代码、模型和训练数据都已经开源,有7B和13B两个参数量的模型,均为全量微调,LoRA版本也将很快发布。

LLaVA相关论文的第一作者是威斯康星大学麦迪逊分校的华人博士生Haotian Liu。

他还是一名浙大竺院校友,期间师从计算机学院金小刚教授和吴飞教授。

他的现任导师Yong Jae Lee则是相关论文的通讯作者。

此外,来自微软研究院和哥伦比亚大学的学者也有参与LLaVA的相关工作。

项目主页(内含DEMO及GitHub、HuggingFace链接):https://llava-vl.github.io/

论文地址:[1]https://arxiv.org/abs/2304.08485[2]https://arxiv.org/abs/2310.03744